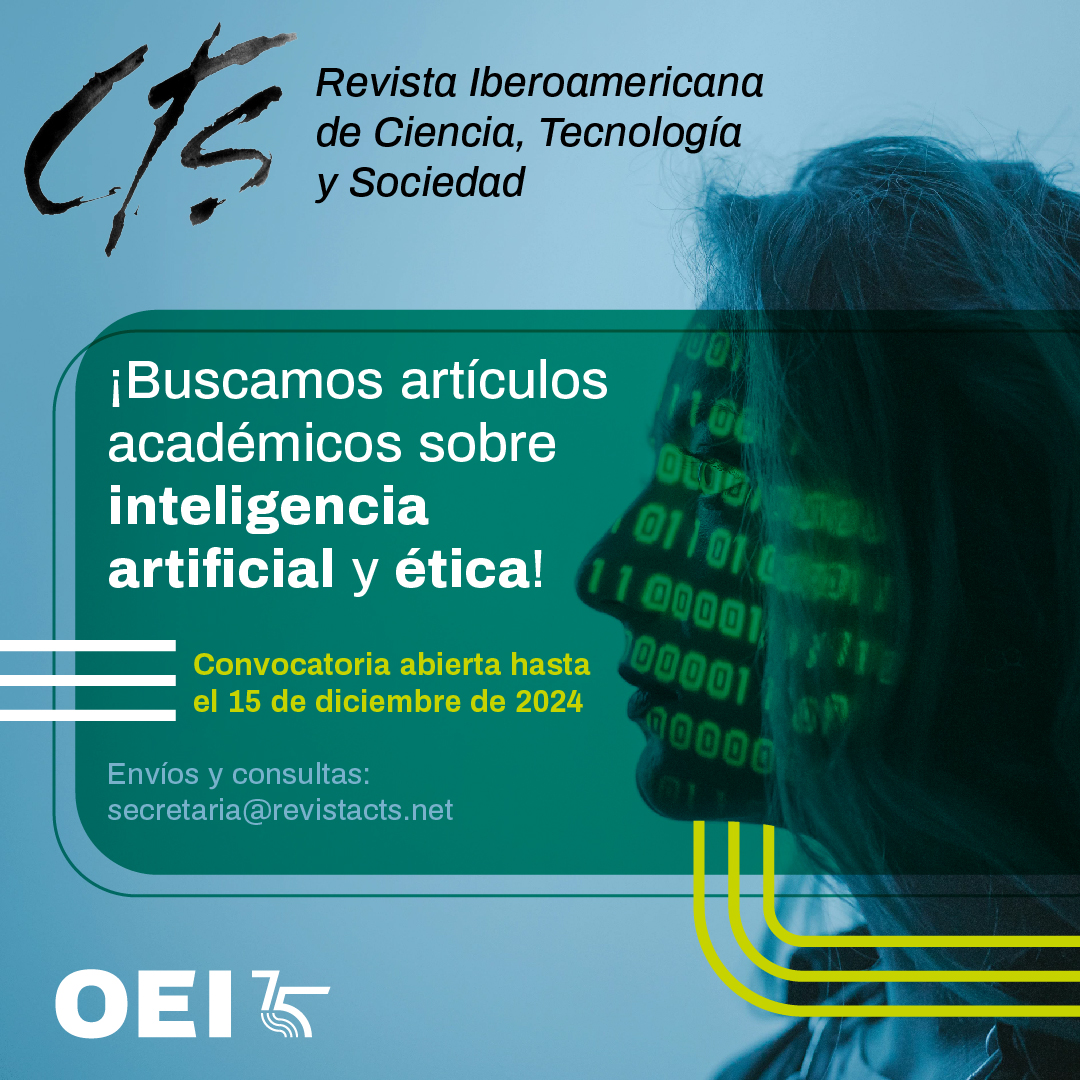

La Revista CTS abre una convocatoria a artículos académicos sobre inteligencia artificial y ética

Hasta el 15 de diciembre de 2024 estará abierta la convocatoria para el envío de artículos académicos con destino a una próxima edición de la Revista Iberoamericana de Ciencia, Tecnología y Sociedad -CTS, que tendrá como título “Inteligencia artificial y ética” y será publicada en 2025.

Los trabajos recibidos serán considerados en primera instancia por un comité de lectura coordinado por los expertos Esmeralda García Sánchez e Ismael Gómez García. Los textos seleccionados en esa etapa serán luego evaluados por pares anónimos, que podrán solicitar correcciones y relecturas.

Con la idea de facilitar la primera etapa de la convocatoria, solicitamos que los trabajos se ajusten a lo requerido por la normativa de CTS para los siguientes aspectos formales: extensión, formato de bibliografía, carátula, fuente, etc.

Los artículos deberán ser enviados a secretaria@revistacts.net con el asunto “CONVOCATORIA INTELIGENCIA ARTIFICIAL Y ÉTICA” y en dos versiones:

i) una anonimizada, sin referencias de autoría en carátula y cuerpo de texto;

ii) otra con el nombre del autor y sus datos principales: filiación, estudios, ORCID, correo electrónico.

Todos los artículos deberán ser originales y rigurosamente inéditos. Una vez que se anuncie la selección final, los textos elegidos deberán ser cargados por sus autores en la plataforma OJS de la revista, desde donde se iniciará el proceso de evaluación.

Sobre la convocatoria

Sam Altman, CEO de OpenAI, ha llegado a afirmar que, para entender plenamente el universo, necesitaremos una inteligencia artificial general (IAG) capaz de superar en cognición a los humanos. Según Altman, esa IA es un instrumento tan necesario como el telescopio para entender las galaxias. Nuestras facultades humanas simplemente no son lo suficientemente buenas para ayudarnos a encontrar el sentido de la realidad.

¿Es la IA un avance tecnológico más, por muy potente que sea, o nos hallamos ante un nuevo tipo de conocimiento? ¿Se trata de un nuevo Prometeo? ¿Significan los recientes avances en IA que estamos más cerca de conocer cómo funciona la inteligencia humana y cómo tomamos decisiones?

La IA parece ser la tecnología más potente jamás desarrollada por el ser humano para el manejo de datos, hasta tal punto que muchas personas creen que podremos confiar a la IA la toma de decisiones clave para el futuro de la humanidad. Sin embargo, nadie, ni siquiera los más expertos investigadores en el campo de la IA, saben exactamente cómo funciona el aprendizaje profundo (deep learning), la tecnología que está a la base de todos estos recientes avances.

Las vastísimas necesidades de computación de la IA han disparado el consumo de energía y de recursos naturales como el agua, necesaria para refrigerar los centros de datos. Ante la rápida difusión de la IA en diferentes campos -sus usos con visibles beneficios y ventajas, pero también con muchos riesgos y perversiones de negocio-, se ha abierto un gran debate sobre cuestiones como el diseño de los sistemas de IA, la llamada “justicia de datos”, los sesgos de los algoritmos, los valores éticos y los conceptos de autonomía y responsabilidad; sin olvidar el ámbito legal y sus implicaciones éticas en cuestiones de privacidad y libertad de expresión.

Con el fin de fomentar la curiosidad, el análisis y la reflexión, desde CTS queremos profundizar en varios temas relacionados con dicho debate y abrir un diálogo sobre las implicaciones éticas, sociales y filosóficas de la IA. Así pues, invitamos a la remisión de artículos académicos que aborden las siguientes líneas de investigación: ¿Puede la IA ser una herramienta neutral? ¿Es viable conseguir una IA que proporcione un servicio de bienestar social?

Los sesgos de los algoritmos: auditoría de los algoritmos, análisis y crítica de la neutralidad y objetivos algorítmicos. Posibilidad de crear algoritmos justos.

- ¿Es necesario para el futuro de la humanidad que las máquinas lleguen a pensar?

- ¿Es lo mismo control que inteligencia? ¿Traerá la IA más libertad para la humanidad o podríamos estar ante un perfecto instrumento de control social?

- ¿Qué consecuencias tiene la concentración de la vanguardia de la IA para las perspectivas éticas de las relaciones globales?

- ¿Qué significa decir que la inteligencia artificial puede llegar a superar las capacidades humanas? En el caso de que ese objetivo se lograra, ¿sería éticamente obligatoria la emancipación de una inteligencia así?

- ¿Qué significa para la discusión ética aceptar que la IA puede solucionar todos los problemas de la humanidad, presentes y futuros?

Diseño ético de la IA y responsabilidad de los diseñadores:

a) Incorporación de principios éticos y consideraciones morales en el desarrollo e implementación de la IA. Posibilidad de directrices éticas para el diseño y uso de la IA: viabilidad y conveniencia.

b) Estatus deontológico y moral de los diseñadores. Riesgos de los usuarios.

c) Beneficios de los investigadores:

– Abordaje de la regulación de la IA y la necesidad de políticas y legislaciones éticas para acomodar la IA al bienestar social (importancia de la discriminación racial y de género, desigualdad, segregación social, pobreza, crimen) y al desarrollo sostenible de la humanidad. Aplicabilidad de la misma por parte de los gobiernos.

– Evaluación del diseño de la IA: responsabilidad social y corporativa de las empresas públicas y privadas.

– Imbricación de la IA, la ética y el conocimiento. Necesidad de fomentar la curiosidad, la autonomía y responsabilidad del usuario, más que darle respuestas concluyentes. Derecho de todos los ciudadanos a ser educados en la IA para entenderla.